| |

Как сделать свой сайт «любимчиком» поисковой системы?

Как сделать свой сайт «любимчиком» поисковой системы?

|

Андрей Калинин, руководитель проекта Поиск Mail.ru, был очень рад знаменательному событию этого года — полному переходу Поиска Mail.ru на собственный движок. В связи с этим важным событием он решил рассказать о «кухне» поисковой системы на конференции CyberMarketing-2013. |

Безусловно, в России уже есть и давно действуют поисковые системы, работающие на своих движках, но их очень мало, поэтому еще один не помешает никому. А возможно, даже станет выгоднее, чем остальные, так как имеет отличающуюся политику и неплохой охват пользователей — 25-27 млн человек. Что волнует оптимизаторов и вебмастеров? Индексирование всего сайта Появление сайта в выдаче по определенным запросам Трафик

Как добиться отличного индексирования?

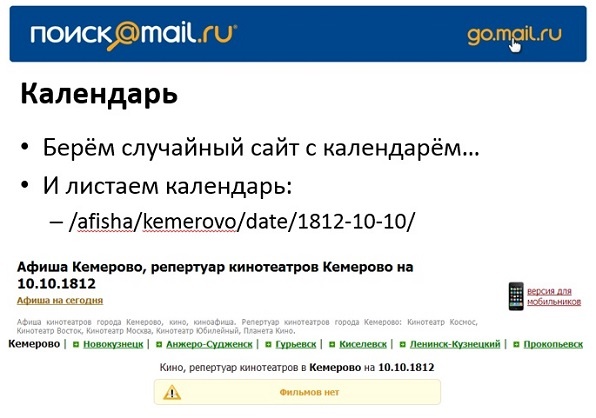

Первое правило — сделать свой сайт максимально доступным для поисковика. Бывает такое, что вебмастера и оптимизаторы даже не в курсе, что их сайт (или некоторые его страницы) заблокированы поисковиками. Это может произойти совершенно случайно, например, по недосмотру сисадмина, которому вдруг не понравилось появление поискового робота в логах. После устранения подобной проблемы у поисковика возникает другой важный вопрос: «Сколько страниц сайта скачивать?» Конечно же, вебмастер попросит скачать все, опять же иногда и не догадываясь, сколько тысяч неизвестных страниц у его сайта. Все дело в том, что сайт, созданный автоматически, позволяет генерировать неограниченное количество url. Это технический мусор. К нему относятся многие «незаметные» особенности: Списки товаров. Когда сайт построен так, что при каждой сортировке (по дате, по виду продукции, по размерному ряду или по сезонности) открывается новый адрес, то количество расплодившихся адресов в итоге стремится к бесконечности. Разделение по регионам. Отдельный сайт (со всеми вкладками) для каждого региона присутствия компании множит количество адресов. Облака тегов. Здесь тоже все хорошо в меру. Афиша. Опытным путем выяснилось, что некоторые афиши можно пролистать назад аж до 1812 года и понять, что в тот день фильмов на экране не было.

В конечном счете, если взять случайную страницу в сети, то чаще всего это будет технический мусор — вариант «кривого» url, сделанный нерадивым программистом. Поисковые роботы не имеют возможности понять, какая из страниц нужная, а какая появилась случайно. Поэтому выделяется некоторая квота скачиваний для отдельного сайта, зависящая от его посещаемости, от разнообразности и полезности информации на нем. Как поисковики ведут борьбу с техническим мусором?

При обработке крупных сайтов, которые имеют более 1000 url, проходит процедура автоматической сегментации: поисковик пытается понять структуру сайта по тем адресам, какие у него есть. Адреса группируются автоматически, собираются «регулярные выражения», и выделяются наиболее интересные для поиска сегменты. Отдельно остаются сегменты архивов и дублей, чтобы политика обхода была гибкой и постоянно обновляющейся. Фактически это выглядит так: каждый сайт «подбрасывается» в выдачу и создает определенную картину, которая анализируется. Иногда полный анализ занимает около года. Самый простой способ очистить сайт от технического мусора — в robots.txt записать url-исключения, которые ни в коем случае не должны попасть в выдачу и засорить ее. Это дает сразу несколько плюсов для вебмастера.

Если же вебмастер компании не может обойтись собственными силами, то он пользуется услугами поисковика: отправляет запрос и получает страницу анализа сайта с выделенными сегментами. А затем уже самостоятельно решает, что нужно, а что является мусором и подлежит удалению.

В свою очередь поисковой системе важно узнать, помог ли этот способ в решении проблем с индексированием или нет — нужна обратная связь. Как заставить сайт стабильно появляться в выдаче?

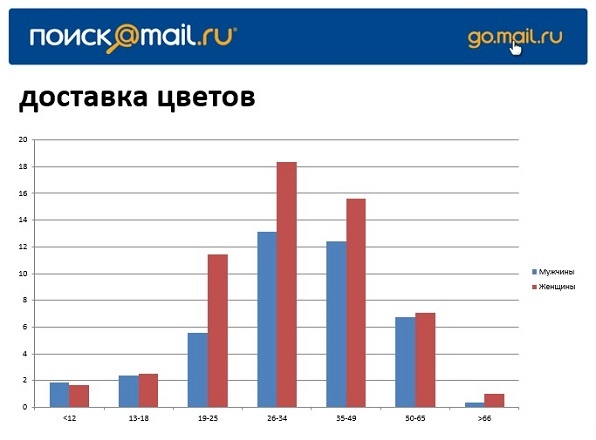

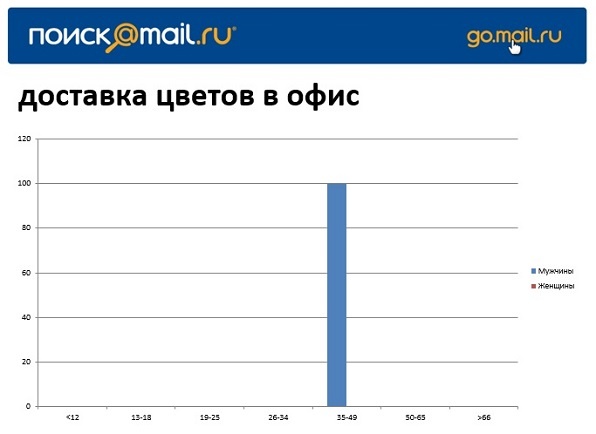

Самый распространенный вопрос от владельцев сайтов: где покупать ссылки и сколько они стоят? Несомненно, это важно, но только после выбора запросов, по которым будете оптимизировать. Если взять из чистых логов обращения к поиску про доставку цветов обычными пользователями, то обнаружим разницу между двумя похожими запросами.

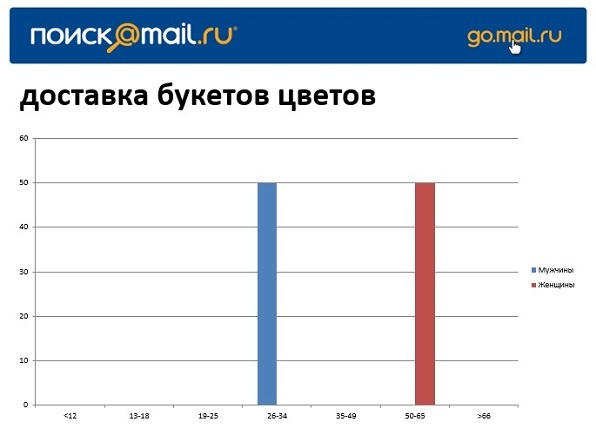

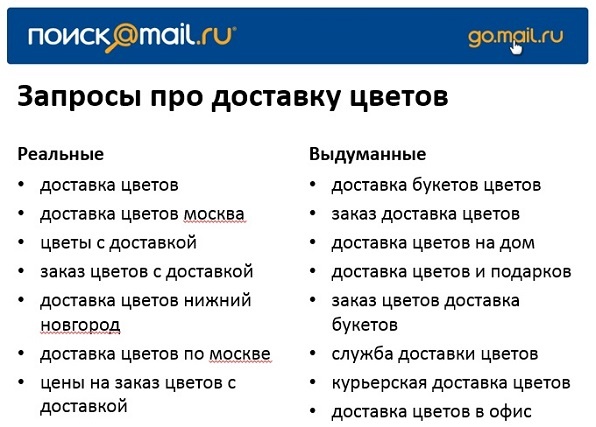

Отсюда понятно, что «доставка букетов цветов» — лишний запрос. Это искусственный запрос, созданный для того, чтобы сбивать позиции. Живых таких запросов нет. Частоту создали «паразитным» трафиком, после чего огромное количество оптимизаторов решили продвигаться по этому запросу. К числу таких же запросов можно отнести «доставка цветов в офис».

Существует список реальных и выдуманных запросов:

Кто-то может считать такие запросы разбавкой, но все-таки настоящий оптимизатор должен ставить перед собой цель достичь определенной позиции в выдаче. А искусственные запросы затрудняют путь к цели. Поэтому поисковые системы ведут постоянную борьбу с ними: ставят капчу для отсеивания ботов, а во всех остальных случаях оставляют в выдаче для дальнейших исследований. Создавать отдельную выдачу для искусственных запросов в планы поисковиков не входит, хотя по этому поводу есть множество мнений оптимизаторов. Самые главные факторы продвижения

Высокочастотные и низкочастотные запросы имеют много определений. Для поисковых систем ВЧ-запрос — это запрос, обеспеченный поведенческой информацией, поэтому ранжирующийся лучше остальных. НЧ-запросы — редко встречающиеся запросы, их сложно предсказать и никакой информацией они не подкреплены. Одними ссылками продвинуть сайт сложно, поэтому нужно уделять внимание поведенческим факторам — они являются одними из самых главных и позволяют узнать, насколько ваш контент хорош или чего не хватает на странице, чтобы пользователь выполнил то или иное действие. Хорошо работает на продвижение общая авторитетность сайта — это поведенческий индекс качества, который можно увидеть в «Кабинете вебмастера». В нем есть две метрики, позволяющие понять, насколько качественный у вас сайт. Это СУП (Средняя удовлетворенность пользователя) и СПД (средняя привлекательность документа). Второе место занимает качество контента, а третье — ссылки.

Выводы

Чтобы сайт нравился поисковым системам и был успешен в выдаче, необходимо тесное взаимодействие оптимизаторов и специалистов поисковиков. Не стоит отказываться от получения дополнительной информации, например, важных метрик, отражающих отношение пользователей к вашему сайту. Эти данные существенно облегчат продвижение и помогут избавиться от очевидных ошибок, которых, на первый взгляд, не видно.

|

|

|

| |

Витрины товаров Admitad — работа над ошибками

10 декабря, ведущий: Алексей Терехов Несколько лет назад Алексей защитил кандидатскую диссертацию по теме, связанной с информационным поиском, что позволило ему не только стать специалистом партнерской сети Admitad, но и быть ведущим специализированных семинаров. На этот раз он расскажет о причинах слабой работы витрин товаров и отсутствия индексации «Яндекса»; о том, как обойтись без кнопки «купить»; о скрытых возможностях новых доменов и факторах, убивающих конверсию. Создание сайта для заработка

11 декабря, ведущий: Дмитрий Шучалин Дмитрий Шучалин, руководитель службы технической поддержки TrustLink, по праву считается профи в области монетизации интернет-ресурсов. Он знает, как заставить сайт приносить доход. И с радостью делится своими знаниями и опытом с заинтересованными слушателями. На семинаре вы узнаете, как выбрать домен, раздобыть контент, нарастить параметры и обойти подводные камни — не попасть под фильтры поисковиков. Вебинар «Лидогенерация или Как организовать поток заявок в ваш бизнес»

11 декабря, ведущий: Данил Баженов На вебинаре, посвященном лидогенерации, Данил предоставит подробное руководство к действию. Сначала опишет общую схему функционирования лидогенерации, потом детальнее остановится на источниках трафика, отдельно акцентирует Landing page, а в заключение разберет этапы обработки и квалификации лидов. Особо ценным вебинар станет для новичков в данной сфере.

|

|

| |

Google разработал замену сложным паролям

Новая система аутентификации от Google в скором времени будет представлена широкому кругу пользователей. Она включает в себя устройство YubiKey Neo, подключаемое к девайсу через USB-порт и идентифицирующее пользователя с помощью PIN-кода, сообщается на сайте forbes.com. Чтобы войти в аккаунт, требуется одновременно PIN и ключ. Технология YubiKey Neo доступна на смартфонах, имеющих чип NFC, что позволяет не использовать дополнительные устройства. Пока система проходит тестирование сотрудниками Google, а официальный релиз YubiKey Neo намечен на 2014 год. Новые алгоритмы Google Trends

Команда сервиса Google Trends, который позволяет следить за динамикой популярных запросов, запустила бета-тестирование новых алгоритмов. Нововведение коснулось 2 типов запросов: содержащих слова с несколькими значениями и имеющих разные варианты написания. В первом случае новые алгоритмы теперь уточняют запрос, чтобы отсеять ненужные значения. Если же поисковая фраза или слово может вводиться по-разному, то Google Trends объединяет все варианты, для более объективной статистики. Эти нововведения призваны сделать сервис более гибким и точным, что, несомненно, должны оценить многие специалисты. Поиск@Mail.ru представил новые подсказки

Отныне в поисковой строке при запросе будут выдаваться результаты не только совпадающих начальных букв или слов, но и комбинаций букв, расположенных в любой части слов. Набирая в строке название фильма, пользователь получит необходимую справочную информацию о нем, а в выдаче видеохостингов — постер к ролику с указанием его длительности, сообщается в блоге компании. В мобильной версии поиска по приложениям появились категории: платные, бесплатные и популярные. Отдельная страница отведена информационным сообщениям от новостных партнеров компании.

|

|

Как сделать свой сайт «любимчиком» поисковой системы?

Как сделать свой сайт «любимчиком» поисковой системы?

Можно ли использовать небольшие фрагменты контента с других сайтов?

Можно ли использовать небольшие фрагменты контента с других сайтов?

Мы открыты для ваших предложений

Если у Вас есть интересная тема для нашей рассылки, которая интересует Вас больше всего мы готовы осветить ее в наших выпусках. Присылайте название темы и краткие тезисы и в скором времени Вы получите выпуск рассылки на Вашу тему.